KIS-redaktionen:

Vi bringer her en tankevækkende artikel skrevet af Jacob Mchangama direktør for tænketanken Justitia i Danmark, men først en lille introduktion fra KIS-redaktionen.

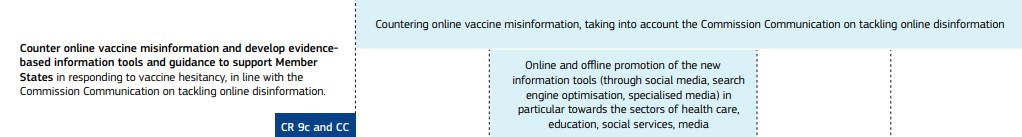

Det har siden 2018 været kendt, at EU har samarbejdet med bl.a. Google og Facebook om at undertrykke kritiske søgeresultater angående Covid-19 vaccineskader i forbindelse med indførelsen af et EU-vaccinationspas. Det er alt sammen skitseret i EU´s projektplan 2018-2022 som er at finde på EU´s hjemmeside. Mange mennesker tror fejlagtigt at dette er en konspirationsteori. Man tager sig til hovedet nogen gange. Men en sådan plan kræver megen forberedelse, så det er ikke usandsynligt at den har været i støbeskeen i flere år før ikrafttrædelsen, og en meget belejlig pandemi. Her er den:

ROADMAP FOR THE IMPLEMENTATION OF ACTIONS BY THE EUROPEAN COMMISSION BASED ON THE COMMISSION

COMMUNICATION AND THE COUNCIL RECOMMENDATION ON STRENGTHENING COOPERATION AGAINST VACCINE

PREVENTABLE DISEASES.

https://health.ec.europa.eu/publications/roadmap-implementation-actions_en

Du kan også læse og evt. downloade pdf-dokumentet her:

Elon Musk og tvitter-dokumenter

Elon Musk er lige nu i gang med at offentliggøre censur strategi-dokumenter fra twitters egen administration. De giver indblik i hvor omfattende og forgrenet censuren har været i USA. Det vedrører tilsyneladende både det amerikanske præsidentvalg i 2020, Covid19 lockdown-politikken og sikkert mange andre forhold, herunder Ukraine. Vi får se hvis Musk fortsætter sit gode oplysningsarbejde.

For amerikanerne har dette været en meget chokerende oplevelse og det fortsætter tilsyneladende med at udfolde sig i mainstream.

I EU er meget få mennesker vidende om, at der længe har været censur i samme grad som den vi nu ser udfolde sig i USA. I Danmark har hverken presse eller politikere omtalt de drastiske tiltag skitseret i indledningen, som i øvrigt også nu omfatter krigen i Ukraine.

I denne forbindelse er samtlige borgere i Europa blevet nægtet internet-adgang til russiske medier så som Russia Today og Sputnik News. Argumentet for denne totale censur har været, som altid “med de russere”, at de spreder misinformation og fake news. Dette er den europæiske befolkning nu blevet hindret i selv at undersøge. Er vi måske for dumme?? Eller orker vi ikke forholde os??

Jacob Mchangama har skrevet en fin artikel desangående. Han er administrerende direktør for Justitia, en københavnsk tænketank med fokus på menneskerettigheder og retsstaten og forfatter til Free Speech: A History From Socrates to Social Media (2022 Basic Books).

Læs artiklen og dan din egen mening. Tro ikke blindt på hvad KIS-redaktionen eller Jacob Mchangama fortæller dig, men vær kritisk i din egen research. Dette er vejen frem i alle henseender!!! Derfor skal vi altid have tilgang til en stor bredde af information.

Kun løgnen ønsker at undertrykke data og fakta. Sandheden har allerede lagt sine frem!

Den reelle trussel mod sociale medier er Europa

Af Jacob Mchangama – CEO for Justitia, en københavnsk tænketank med fokus på menneskerettigheder.

Kilde: Foreignpolicy.com – 25. april 2022

EU vedtager lovgivning, der vil svække lovene om ytringsfrihed ud over bristepunktet.

Elon Musks erhvervelse af Twitter har forårsaget frygt og afsky blandt eksperter og politikere, der er på vagt over for hans løfte om at føre platformen tilbage til sin oprindelige position som “ytringsfrihedspartiets fløj.”

Disse frygtsomme eliter vil måske søge trøst i Europa, hvor Musks tekno-utopiske drømme om ytringsfrihed på nettet, nu står over for hidtil usete forhindringer. Om de vil genkende de dystopiske aspekter af Europas egen teknologiske kultur, er et andet spørgsmål.

Digital Service Act

Den Europæiske Union er midt i færdiggørelsen af Digital Services Act (DSA), et ambitiøst lovgivningsforsøg på at skabe en “global gylden standard” for platformsregulering. Efter fem triloger nåede Europa-Parlamentet og Det Europæiske Råd den 23. april en foreløbig politisk aftale om DSA. I betragtning af EU’s økonomiske og politiske indflydelse, kan DSA have en væsentlig indflydelse uden for Europa gennem den såkaldte “Brussels EffectBrussels Effect“. Som sådan vil DSA sandsynligvis påvirke den praktiske udøvelse af ytringsfrihed på sociale medieplatforme, uanset om de er placeret i Silicon Valley eller ejes af amerikanske teknologimilliardærer.

Mens ytringsfriheden er beskyttet af både EU’s charter om grundlæggende rettigheder og den europæiske menneskerettighedskonvention, giver disse juridiske instrumenter regeringer meget større spillerum end den første ændring af den amerikanske forfatning, når det kommer til at definere kategorier, såsom hadefulde ytringer, som kan reguleres. Ej heller yder europæisk lovgivning en særlig robust beskyttelse mod formidleransvar som paragraf 230 i Communications Decency Act, som beskytter amerikanske onlineplatforme mod ansvar for det meste brugergenereret indhold.

Brugerne i fokus

Denne balancerende tilgang til ytringsfrihed blandt europæiske demokratier fremgår af indholdet af DSA. Teksten indeholder nogle elementer, der fortjener ros. Dette omfatter større gennemsigtighedsforpligtelser på store sociale medieplatforme for at løfte sløret for deres fjernelses-beslutninger samt offentliggørelse af årlige rapporter om indholds-moderering og håndhævelse. Dette vil give brugerne mulighed for bedre at forstå, hvordan indhold anbefales til dem, og hvordan moderationsbeslutninger træffes; brugere vil også nyde ret til genindsættelse, hvis platforme laver fejl. Det er også et positivt skridt, at DSA ikke pålægger generelle overvågningsforpligtelser på sociale medieplatforme, som dermed yderligere vil øge brugen af indholdsfiltreringsalgoritmer til at scanne, markere og fjerne angiveligt ulovligt indhold.

Men på trods af disse positive elementer, finder DSA ikke den rette balance mellem at imødegå ægte online skader og at beskytte ytringsfriheden. Det vil højst sandsynligt resultere i et krympende rum for online udtryk, da sociale medievirksomheder er tilskyndet til at slette massive mængder af helt lovligt indhold.

DSA

Faktisk indeholder DSA en række funktioner, der sandsynligvis vil forårsage alvorlige skader på ytringsfriheden online i Europa. Paradigmet med korte obligatoriske fjernelsesgrænser, som kræver, at platforme hurtigt sletter rapporteret ulovligt indhold, eller, i modsat fald, står over for høje bøder, blev først vedtaget af Tyskland i 2017 som en del af Network Enforcement Act, eller NetzDG. I 2020 var det blevet copy-pastet af mere end 20 lande, herunder autoritære regimer som Rusland og Tyrkiet. Denne tilgang er nu delvist gentaget i DSA, som etablerer en “meddelelse og handling”-mekanisme. Mellemmænd bør handle efter modtagelsen af en sådan meddelelse “uden unødig forsinkelse”, under hensyntagen til typen af indhold og om det haster med fjernelse. Meget store onlineplatforme risikerer bøder på op til 6 procent af deres årlige verdensomspændende omsætning i tilfælde af manglende overholdelse. Selvom der ikke er nogen eksplicitte tidsbegrænsninger, er den obligatoriske fjernelsestilgang klart inspireret af NetzDG. Lovgivning, der forpligter platforme til at fjerne ulovligt indhold på kort tid, er problematisk af mindst tre grunde.

For det første, mens mange politikere rammer en overflod af spørgsmål, herunder terrorpropaganda online, hadefulde ytringer og disinformation, med hensyn til indholdets ulovlighed, tyder tilgængelige data på, at det meste af det problematiske indhold online er lovligt.

AI sletter lovligt indhold

En nylig juridisk analyse (som jeg var medforfatter til) af 63 millioner danske Facebook-kommentarer, viste, at mens en algoritme baseret på Facebooks fællesskabsstandarder fandt, at 1,4 procent af kommentarerne udgjorde “hadfulde angreb”, var det kun omkring 0,0066 procent, der rent faktisk overtrådte relevante bestemmelser i Dansk straffelov om hadefulde ytringer, trusler, glorificering af terrorisme, tilskyndelse til ulovlige handlinger og trusler og fornærmelser af embedsmænd. En anden undersøgelse, jeg var medforfatter af, af fem danske mediers Facebook-konti, viste, at kun 1,1 procent af de slettede kommentarer overtrådte straffeloven, mens næsten halvdelen af de slettede kommentarer ikke var hadefulde, stødende eller truende. Ligeledes viste en undersøgelse fra 2021, at i modsætning til populære opfattelser i medierne, resulterede Donald Trumps antændende præsidentkampagne i 2016 ikke i en stigning i hadefuld retorik på Twitter. Derfor udgør de mest populære sociale medieplatforme næppe det “vilde vesten“, som de ofte opfattes som, af fremtrædende europæiske politikere som Emmanuel Macron.

For det andet er det juridiske spørgsmål om at afgøre, om en ytring er ulovlig, komplekst. En rapport fra 2021, som jeg var medforfatter til, fandt, at nationale domstole i fem europæiske demokratier i gennemsnit bruger 778,47 dage på at afgøre sager om hadefulde ytringer. Ved at pålægge korte obligatoriske nedtagningsgrænser kræver regeringer, at teknologiplatforme træffer juridiske beslutninger, der tager uddannede retseksperter måneder eller år at beslutte på blot et par timer eller dage. Dette vil næsten uundgåeligt resultere i, at platforme tager fejl ved fjernelse, givet de høje bøder for manglende overholdelse, hvilket skaber et stærkt økonomisk incitament til at rense i stedet for at beskytte brugernes tale.

Utilsigtede effekter af indholdsmoderering

Alt i alt vil disse aspekter af DSA sandsynligvis resultere i væsentlige skader på ytringsfriheden, idet de påvirker almindelige menneskers mulighed for at debattere spørgsmål som immigration, køn, religion og identitet, og også nogle gange gå ud over de minoritetsgrupper, som had-tale-forbuddet skal beskytte.

Ovenstående indvendinger var også grunden til, at det franske forfatningsråd erklærede dele af den såkaldte Avia-lov (en fransk NetzDG-klon) som forfatningsstridige krænkelser af ytringsfriheden, hvorfor FN’s Menneskerettighedskomité udtrykte bekymring over NetzDG’s overholdelse af ytringsfrihedens normer under international menneskerettighedslovgivning (IHRL).

Tilhængere af skrappere regulering af indholdsmoderering peger ofte på undersøgelser, der viser, at NetzDG ikke har resulteret i massefjernelsesanmodninger eller “overblokering.” Sådanne undersøgelser savner imidlertid den mest dybtgående effekt af obligatoriske varsel og fjernelsesordninger. I stedet for at reagere på brugerklager udvider platforme proaktivt deres egne definitioner af hadefulde ytringer og andre forbudte kategorier i deres kommissorium, og øger automatisk indholdsmoderering for at opdage og slette stødende indhold, før nogen bruger har mulighed for at klage.

I første kvartal af 2018 fjernede Facebook 2,5 millioner stykker indhold for overtrædelse af fællesskabets standarder for hadefulde ytringer. I tredje kvartal af 2021 var antallet næsten tidoblet til 22,3 millioner. Dette var hovedsageligt resultatet af en øget tiltro til AI-baserede indholdsfiltreringsalgoritmer. I 2018 fangede AI 4 ud af 10 overtrædelser før nogen brugerklage, men i tredje kvartal af 2021 steg dette til 96,5 procent.

Modsat effekt end forventet

Ironisk nok er resultatet af denne udvikling, at love der sigter mod at skabe demokratisk ansvarlighed på private megaplatforme, ender med at overdrage endnu mere magt til disse platforme når det kommer til at regulere talen fra de milliarder af mennesker, der er afhængige af sociale medier for at dele og få adgang til information og meninger.

Den ubehagelige sandhed er, at når det kommer til regulering af ytringer på globale centraliserede sociale medieplatforme, er der ingen “perfekt mellemvej” – kun et sæt uperfekte politikker, der uundgåeligt inkluderer dilemmaer og afvejninger.

Der er dog alternative modeller til DSA, som ville give stærkere ytringsfrihed og styrke brugerne på bekostning af den øgede platformsmagt. En model ville være, at tilskynde til implementering af menneskerettighedsstandarder som en første referenceramme i moderationspraksis på store sociale medieplatforme. Dette ville resultere i et socialt mediemiljø, der ville være både mere gennemsigtigt og beskyttende for brugernes ytringsfrihed, i kategorier som hadefulde ytringer og desinformation. At bruge menneskerettighedslovgivningen som standarden for indholdsmoderering ville også give platforme normer og legitimitet til at modstå krav om at censurere uenighed, fremsat af autoritære stater der er ivrige efter at udnytte demokratiernes velmenende, men vildledte forsøg på at tøjle skadelig onlinetale.

IHRL

IHRL er dog ikke et vidundermiddel og behandler ikke kategorier som spam og porno. Selv hvis menneskerettighedsnormer er mere gennemsigtige og konsistente end de nuværende servicevilkår for spørgsmål som hadefulde ytringer og desinformation, vil anvendelsen af disse normer i stor skala, på platforme der letter hundreder af millioner – eller endda milliarder – af brugere, i bedste fald falde men ikke eliminere antallet af tvivlsomme og forkerte beslutninger fra både menneskelige og automatiserede indholdsmoderatorer.

Desuden vil mange brugere sandsynligvis modsætte sig menneskerettighedsstandarder, da menneskerettighedslovgivningen beskytter mange ytringer der er “forfærdelige men lovligt”, og driver brugere væk – og dermed i sidste ende indtægter – hvilket formentlig vil gøre indtryk på selv Musk, der lige har brugt 44 mia. at købe Twitter. Disse bekymringer kan delvist udlignes ved at give brugerne mere kontrol over ytringer gennem forskellige metoder til distribueret indholdsmoderering. For eksempel rapporterer mange kvinder, at de bliver konfronteret med misogynt misbrug, hvilket får nogle til at selvcensurere eller endda forlade platforme. Men hvis tredjeparter, såsom kvinderettighedsorganisationer, fik lov til at udvikle frivillige filtre, som individuelle brugere kunne anvende efter behag, kunne kvinder undgå meget af det misbrug, der kunne være lovligt, men ikke desto mindre er sårende, skræmmende og afskrækkende. Sådanne “medbring-selv-filtre” kunne også bruges til anti-LGBT-indhold, antisemitisme, islamofobi osv.

Den åbenlyse fordel ved at kombinere IHRL med distribueret indholdsmoderering er, at det reserverer centraliseret indholdsmoderering til det værste og mest afskyelige indhold, samtidig med at det giver brugerne handlefrihed over det indhold de ønsker at se og engagere sig i. Dette kunne tjene som et brud på censurkapløbet mod bunden, hvor forskellige regeringer og interessegrupper insisterer på, at ytringer som de finder særligt bekymrende, bør forbydes. Platforme har tilsyneladende svært ved at modstå dette, da de i sidste ende er mere optaget af interessentstyring og public relations spørgsmål, der påvirker deres bundlinje, end med at opretholde principielle ytringsfrihedsnormer.

Jacob Mchangama

JM er administrerende direktør for Justitia, en københavnsk tænketank med fokus på menneskerettigheder og retsstaten og forfatter til Free Speech: A History From Socrates to Social Media (2022 Basic Books).

Oversættelse: KIS-redaktionen

Foto: Justitia og Unsplash / Marcus Winckler